Kết quả tìm kiếm cho "deepfake"

Kết quả 37 - 48 trong khoảng 52

-

Tìm điểm cân bằng trong phát triển trí tuệ nhân tạo

17-05-2023 09:49:00Với tiềm năng phát triển to lớn, trí tuệ nhân tạo (AI) đang được ví như thỏi nam châm thu hút đầu tư mạnh mẽ, không chỉ từ các doanh nghiệp mà nhiều quốc gia. Tuy nhiên, bên cạnh nỗ lực nghiên cứu và ứng dụng, các nước cũng nhanh chóng thiết lập “rào chắn an toàn” nhằm kiểm soát những nguy cơ tiềm ẩn của công nghệ tiên tiến này.

-

5 dấu hiệu nhận biết cuộc gọi lừa đảo deepfake

16-05-2023 07:53:53Cục An toàn thông tin đã đưa ra 5 dấu hiệu nhận biết cuộc gọi kiểu deepfake (dùng công nghệ trí tuệ nhân tạo (AI) để tạo ra những video hoặc hình ảnh giả, sao chép chân dung) để lừa đảo.

-

5 dấu hiệu nhận biết cuộc gọi video giả mạo lừa đảo deepfake

08-05-2023 13:55:20Thời gian gần đây, các đối tượng sử dụng cuộc gọi lừa đảo trực tuyến deepfake (dùng công nghệ trí tuệ nhân tạo (AI) để tạo ra những video hoặc hình ảnh giả, sao chép chân dung tạo ra đoạn video giả người thân, bạn bè) để lừa đảo.

-

Cảnh giác các cuộc gọi video call giả mạo

08-05-2023 06:49:44Thời gian gần đây, tình hình tội phạm lừa đảo chiếm đoạt tài sản trên không gian mạng tiếp tục diễn biến phức tạp, với nhiều phương thức, thủ đoạn tinh vi, khó phát hiện. Nắm bắt được tâm lý người dùng mạng xã hội hiện nay đã cảnh giác với thủ đoạn lừa đảo bằng tin nhắn nhờ chuyển tiền, các đối tượng đã sử dụng công nghệ Deepfake làm giả “video call” (cuộc gọi hình ảnh) nhằm chiếm đoạt tài sản.

-

Làm thế nào để tránh bẫy lừa đảo bằng deepfake?

23-04-2023 11:14:03Bạn nên hạn chế chia sẻ hình ảnh, video cá nhân lên mạng xã hội; bảo mật các thông tin cá nhân như số căn cước công dân, địa chỉ nhà riêng, số điện thoại.

-

Cảnh giác giả mạo trên mạng xã hội

24-04-2023 05:28:21Hiện nay, tình trạng lừa đảo qua mạng ngày càng nhiều, với hành vi, thủ đoạn ngày càng tinh vi. Bộ Công an thường xuyên thông tin, cảnh báo hành vi lừa đảo, giả mạo mới, để nâng cao nhận thức của người dân.

-

UBND tỉnh An Giang chỉ đạo tăng cường phòng ngừa tội phạm lừa đảo chiếm đoạt tài sản sử dụng công nghệ Deepfake

19-04-2023 10:53:39Ngày 18/4, Chủ tịch UBND tỉnh An Giang Nguyễn Thanh Bình đã ký Công văn 428/UBND-NC về việc tăng cường phòng ngừa tội phạm lừa đảo chiếm đoạt tài sản sử dụng công nghệ Deepfake.

-

Những thủ đoạn lừa đảo mới trên mạng

12-04-2023 08:19:30Cùng với sự phát triển của công nghệ thông tin, thời gian gần đây đã xuất hiện nhiều phương thức, thủ đoạn lừa đảo mới, tinh vi trên không gian mạng nhằm đánh lừa các nạn nhân để chiếm đoạt tài sản.

-

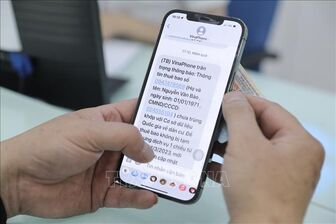

Chuẩn hóa thông tin di động góp phần hạn chế lừa đảo qua điện thoại

03-04-2023 13:48:20Việc chuẩn hóa thông tin là tạo ra sự thống nhất, nhất quán thông tin cá nhân, từ đó tạo ra môi trường dịch vụ thông tin di động văn minh, an toàn cho các hoạt động giao dịch có liên quan đến số điện thoại.

-

Cảnh giác khi nhận tin nhắn, cuộc gọi video vay, mượn tiền qua mạng xã hội

31-03-2023 14:55:14Ngày 31/3, Công an thành phố Hà Nội cho biết, thời gian gần đây, tình hình tội phạm lừa đảo chiếm đoạt tài sản trên không gian mạng diễn biến phức tạp. Nắm bắt được tâm lý người dùng mạng xã hội cảnh giác với thủ đoạn lừa đảo bằng tin nhắn nhờ chuyển tiền, các đối tượng đã sử dụng thủ đoạn tinh vi hơn, lợi dụng công nghệ Deepfake làm giả cuộc gọi video nhằm chiếm đoạt tài sản. Do đó, Công an thành phố Hà Nội đề nghị người dân nâng cao cảnh giác khi nhận bất kỳ tin nhắn, cuộc gọi video với nội dung vay, mượn tiền qua các ứng dụng mạng xã hội.

-

Lo ngại mất kiểm soát từ các ứng dụng Deepfake AI

28-03-2023 14:09:55Theo các chuyên gia công nghệ, các ứng dụng Deepfake AI đang ngày càng phổ biến, thậm chí gây lo ngại về việc mất kiểm soát. Các đối tượng xấu có thể lợi dụng ứng dụng này để thực hiện hành vi lừa đảo.

-

Xuất hiện hành vi ghép mặt, giọng nói giống hệt người thân để lừa đảo

26-03-2023 08:03:54Các đối tượng sử dụng công nghệ Deepfake AI, tạo ra các sản phẩm công nghệ âm thanh, hình ảnh và video với độ chính xác rất cao để lừa đảo.