Giám sát hành vi AI ác ý là một yêu cầu cấp thiết trong năm 2026.

Thách thức của xã hội số

Ngày 21/1, một cụ bà 80 tuổi tại phường Yên Hòa (Hà Nội) đã chuyển 20 triệu đồng cho đối tượng lừa đảo mạo danh cháu nội đang du học tại Mỹ. Dù được người thân can ngăn, bà vẫn khẳng định “không thể nhầm được” vì vừa trò chuyện qua Zalo video với cháu. Kẻ gian đã lợi dụng công nghệ deepfake để tạo hình ảnh và giọng nói giả mạo với mức độ chân thực cao. Sau khi phát hiện bị lừa, cụ bà suy sụp tinh thần, gia đình phải nỗ lực động viên để tránh ảnh hưởng đến sức khỏe của cụ.

Đây chỉ là một trong nhiều vụ việc được dự báo sẽ gia tăng trong năm 2026 - giai đoạn mà các chuyên gia cảnh báo về làn sóng lừa đảo ứng dụng deepfake và AI tạo sinh. Điểm đáng lo ngại là AI cho phép tự động hóa hành vi phạm tội, mở rộng quy mô tiếp cận nạn nhân và tạo ra các nội dung giả mạo có độ thuyết phục ngày càng cao. Nói cách khác, xã hội số đã bước sang giai đoạn trưởng thành hơn, các hành vi sử dụng AI một cách ác ý cũng bộc lộ rõ ràng hơn và trở thành biểu hiện điển hình của giai đoạn này.

Khác với các hình thức tội phạm công nghệ cao trước đây vốn phụ thuộc nhiều vào kỹ năng cá nhân, ngày nay khi “mắt thấy, tai nghe” không còn là căn cứ xác thực đáng tin cậy, nền tảng niềm tin - vốn giữ vai trò cốt lõi trong các quan hệ xã hội - đang đứng trước nguy cơ bị xói mòn.

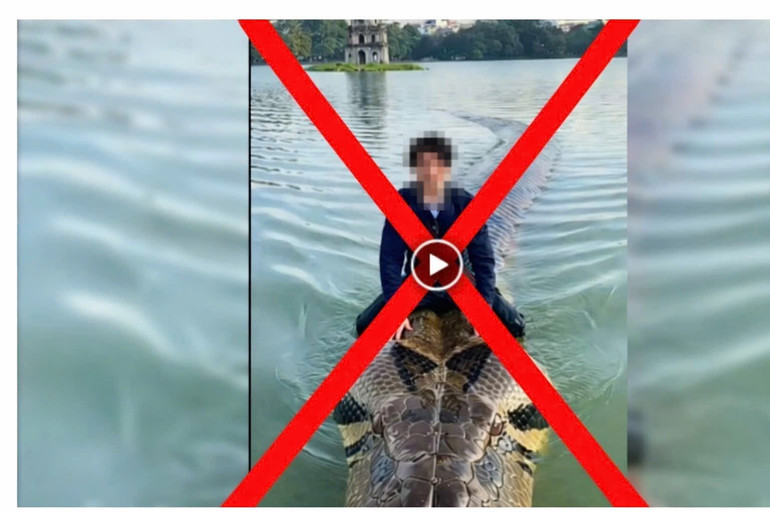

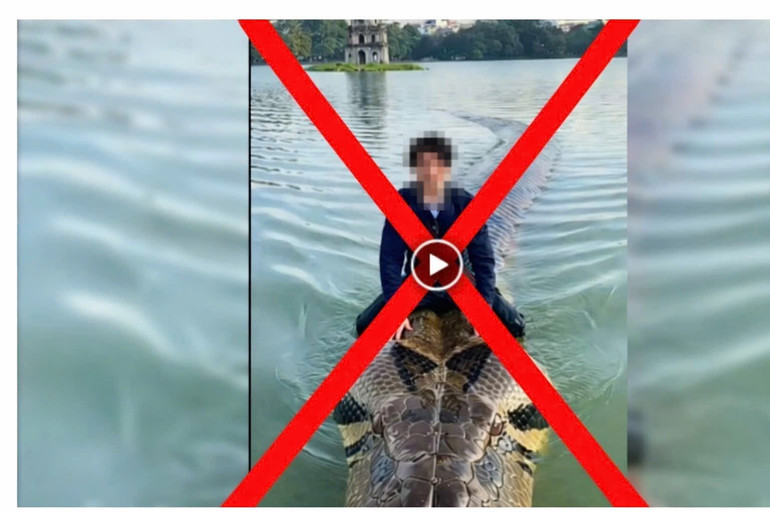

Ngày 8/1, Phòng An ninh mạng và phòng, chống tội phạm sử dụng công nghệ cao (Công an TP Hà Nội) đã xử lý trường hợp công dân N.H.A. sử dụng công nghệ AI để tạo và đăng tải video sai sự thật, gây ảnh hưởng đến hình ảnh các di tích lịch sử, văn hóa và danh lam thắng cảnh của Thủ đô.

N.H.A. thừa nhận đã sử dụng điện thoại để tạo video bằng AI, ghép hình ảnh cá nhân ngồi trên trăn khổng lồ tại hồ Hoàn Kiếm với mục đích “câu like”, “câu view” trên mạng xã hội.

Những vụ việc sử dụng deepfake, giả giọng nói, giả hình ảnh để lừa đảo, tống tiền, thao túng thông tin cho thấy vấn đề không nằm ở bản thân công nghệ, mà ở cách con người kiểm soát và định hướng công nghệ. Ở bình diện rộng hơn, AI bị lạm dụng không chỉ đe dọa tài sản cá nhân mà còn ảnh hưởng đến trật tự xã hội, an ninh thông tin và uy tín của các thiết chế công quyền. Vì vậy, quản lý rủi ro AI cần được đặt ngang hàng với các thách thức an ninh phi truyền thống khác.

Yêu cầu tăng cường giám sát hành vi AI ác ý, đồng thời thiết lập tiêu chuẩn tiếp cận AI an toàn, không còn chỉ là vấn đề kỹ thuật hay pháp lý đơn thuần, mà là câu chuyện về năng lực quản trị quốc gia trong kỷ nguyên số.

Giám sát AI ác ý: Từ phản ứng sang phòng ngừa

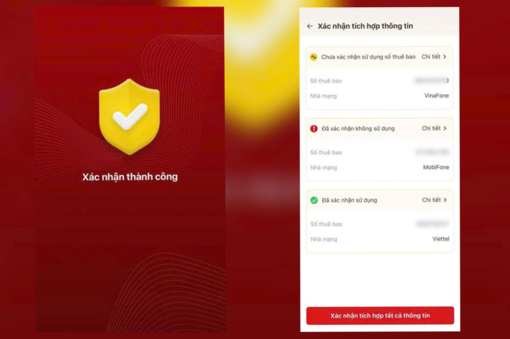

Tại hội thảo “Phòng, chống tội phạm lừa đảo chiếm đoạt tài sản trên không gian mạng” do Bộ Công an tổ chức cuối tháng 12/2025, nhiều giải pháp trọng tâm đã được đề xuất, như nâng cao năng lực phòng, chống tội phạm công nghệ cao; ứng dụng công nghệ xác thực sinh trắc học; xây dựng cơ chế cảnh báo sớm và mô hình trung tâm phản ứng nhanh đối với lừa đảo trực tuyến từ năm 2026.

Một vấn đề đáng lưu ý là dữ liệu cá nhân hiện bị sao chép, lưu trữ phân tán tại nhiều hệ thống khác nhau, làm gia tăng nguy cơ rò rỉ, mua bán và lạm dụng thông tin - yếu tố trực tiếp tiếp tay cho các hành vi sử dụng AI ác ý.

Thực tiễn cho thấy, nếu chỉ xử lý khi hậu quả đã xảy ra, công tác bảo đảm an ninh xã hội sẽ luôn đi sau tội phạm sử dụng công nghệ cao. Với tốc độ phát triển của AI, khoảng cách này có nguy cơ ngày càng gia tăng.

Do đó, giám sát AI ác ý không nên chỉ dừng ở việc tăng nặng chế tài, mà cần được tiếp cận theo hướng phòng ngừa, quản lý rủi ro và giám sát chủ động. Điều này đòi hỏi các giải pháp công nghệ đồng bộ: nâng cao năng lực phát hiện sớm hành vi sử dụng AI có dấu hiệu xâm hại an ninh mạng; thiết lập cơ chế phối hợp hiệu quả giữa cơ quan quản lý, doanh nghiệp công nghệ và các chủ thể liên quan; chuyển trọng tâm từ “xử lý vi phạm” sang “ngăn chặn nguy cơ vi phạm”.

Trong cách tiếp cận này, giám sát không nhằm kiểm soát sáng tạo, mà nhằm bảo đảm công nghệ được sử dụng phù hợp với lợi ích chung và các chuẩn mực xã hội.

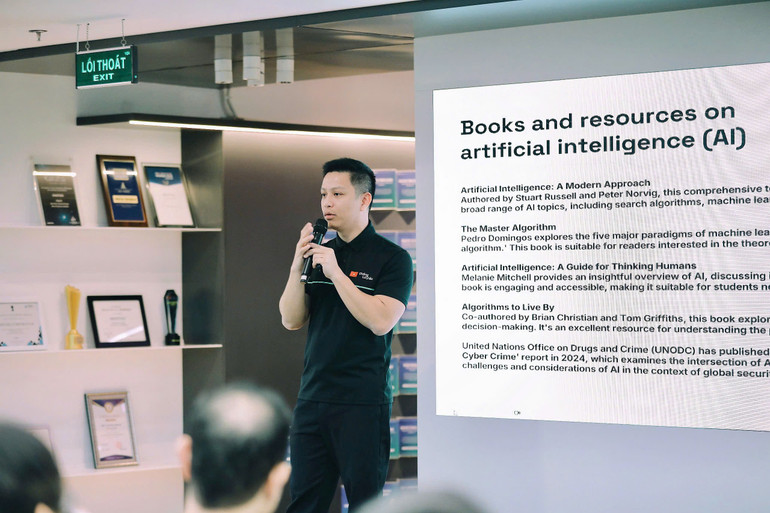

Có thể nhận diện một phần hành vi AI ác ý như deepfake, giả giọng nói, bot lừa đảo… thông qua công nghệ phát hiện AI, phân tích hành vi, đánh dấu số và chia sẻ thông tin về mối đe dọa. Tuy nhiên, chưa có giải pháp nào tuyệt đối, bởi công nghệ tấn công cũng tiến hóa rất nhanh. Do đó cần kết hợp đồng bộ giữa kỹ thuật, con người và pháp lý”.

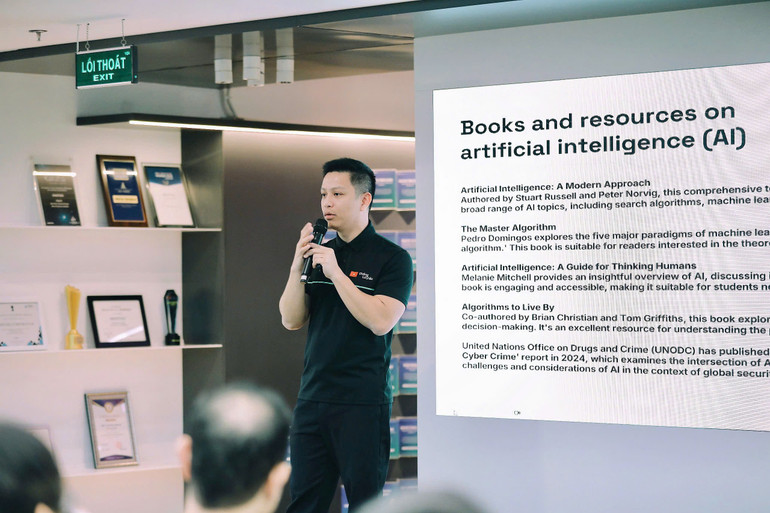

Chuyên gia an ninh mạng Ngô Minh Hiếu.

Chuyên gia an ninh mạng Ngô Minh Hiếu trong một buổi hội thảo về sách và tài liệu, cách tiếp cận hiện đại với AI

Tiếp cận AI an toàn - thước đo năng lực quản trị

Nếu giám sát là điều kiện cần, thì thiết lập tiêu chuẩn tiếp cận AI an toàn chính là điều kiện đủ để quản trị hiệu quả rủi ro từ công nghệ mới. Trong bối cảnh AI ngày càng phổ biến và dễ tiếp cận, việc xác lập các chuẩn mực sử dụng không còn là lựa chọn mà là yêu cầu tất yếu.

Tiêu chuẩn AI an toàn không đồng nghĩa với việc dựng rào cản phát triển công nghệ, mà là xác lập những nguyên tắc cơ bản: ai được tiếp cận, tiếp cận đến mức độ nào và phải chịu trách nhiệm ra sao. Đối với các công cụ AI có khả năng tạo nội dung giả mạo con người, yêu cầu về trách nhiệm pháp lý và đạo đức cần được đặt ra nghiêm ngặt hơn.

Ở góc độ quản trị, tiêu chuẩn tiếp cận AI an toàn là thước đo mức độ trưởng thành của xã hội số. Một xã hội trưởng thành không phải là xã hội ứng dụng nhiều công nghệ nhất, mà là xã hội biết sử dụng công nghệ một cách an toàn, có trách nhiệm và bền vững.

Dữ liệu cá nhân đang bị sao chép và lưu rải rác ở quá nhiều hệ thống, khiến rủi ro rò rỉ, mua bán, lạm dụng thông tin ngày càng lớn.

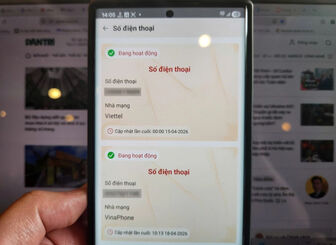

Việc tiếp tục hoàn thiện các quy định phục vụ thi hành Luật An ninh mạng, dự kiến áp dụng từ tháng 7/2026, cho thấy nỗ lực chủ động cập nhật khung pháp lý trước sự biến đổi nhanh chóng của công nghệ. Các quy định này hướng tới làm rõ trách nhiệm của các chủ thể trên không gian mạng, tăng cường cơ chế giám sát, truy vết và bảo vệ dữ liệu cá nhân. Đây không chỉ là công cụ xử lý vi phạm, mà còn là nền tảng pháp lý để định hình hành vi sử dụng AI một cách chuẩn mực ngay từ đầu.

Quan trọng hơn, việc hoàn thiện pháp luật về an ninh mạng trong bối cảnh AI phát triển gửi đi một thông điệp rõ ràng: phát triển công nghệ không thể tách rời yêu cầu bảo đảm an ninh, an toàn và lợi ích quốc gia.

AI sẽ tiếp tục phát triển với tốc độ ngày càng nhanh và phạm vi ảnh hưởng ngày càng rộng. Câu hỏi đặt ra không phải là có nên sử dụng AI hay không, mà là quản trị AI như thế nào. Tăng cường giám sát hành vi AI ác ý và thiết lập tiêu chuẩn tiếp cận AI an toàn chính là hai trụ cột quan trọng để trả lời câu hỏi đó. Đây không chỉ là nhiệm vụ của cơ quan quản lý, mà còn là trách nhiệm chung của toàn xã hội, nhằm bảo đảm công nghệ phục vụ con người, chứ không làm tổn hại đến con người.

Trong kỷ nguyên số, năng lực quản trị công nghệ cũng chính là năng lực bảo vệ các giá trị xã hội. Việc chủ động định hình chuẩn mực cho AI hôm nay sẽ quyết định mức độ an toàn và bền vững của xã hội ngày mai.

Theo Nhân Dân

Đọc nhiều

Đọc nhiều